我这是捅到人家的天花板了。

本文多图多视频。我研究了一下,bilibili的嵌入代码,在后面接autoplay=0这个参数时也能像youtube嵌入代码一样禁止自动播放……(破站怎么自己就懒得写上参数呢。我估计写前端播放界面的人都不在了吧)

(为了省事,下文中 关于 文字生成图片 、 图片生成 、 AI生成图片 等一系列同义词,均使用 文生图 这个词)

前言

是的这一阵子仍然很无聊的在折腾AI,主要是在瞎搞豆包的文字生成图片功能。

画画一直是我可望而不可及的能力,天生没有拿笔画画的能力,我最高也只能做到画几个简单的几何体素描,这还是小学一年级寒假的时候送到画画班学了一个月才会的东西。

再往上就感觉脑子里有个瘤一样。人类做不到自己想象不到的事情,而我很明确的想象不出来自己拿着笔画画的样子,最多也只是在3DS上玩一下 《Colors! 3D》 或者 《绘心教室》。

所以当有一个能出图的工具摆在眼前的时候,肯定是得当作工具好好尝试一下的。

在上一篇文章中也说过了,线下AI文生图工具用不起,线上AI文生图工具不可靠。

只不过这次玩得有点多,我算是把 豆包的AI文生图天花板给捅 了

尝试用豆包文生图功能做漫画

现在我用AI文生图功能基本上只是想做叙事漫画,而之前文章《[原创漫画] 《生命,科技,灵魂,死亡》,以及制作感想》中也讲了,因为这玩意不是人,所以连续出图的连贯性完全没有保证。

第一个思路就是尽量让内容足够简单,这样在内容变化上能尽量保证主体变化不大,不会崩溃。

于是做了这么个玩意。

《[原创漫画] 工作》

只不过叙事结构实在是太过简单了。甚至都抽象不起来。

尝试用豆包 智能编辑 和 区域重绘 功能出图后插帧做动画

我之前想到过,使用智能编辑和区域重绘,一点一点做一个渐变的效果,然后在用 rife 插帧补成动画。

为此还专门撞到了 rife 的 插帧数量 bug 上了。只不过 rife 的原项目早就沉寂了。社区目前或是没人维护,或是一堆不会说人话的莫名其妙脚本小鬼。

这是两个在动画风格下的尝试结果:

《尝试使用「AI智能编辑」+「AI 补帧」制作一个少女变身效果》

《继续 尝试使用「AI智能编辑」+「AI 补帧」制作一个少女变身效果》

只能说效果非常的不好。rife只能根据两帧之间的差别出图,而动画是一个流畅的东西,在 智能编辑 和 区域重绘 这两个功能下根本没有流畅度可言。

我也尝试了用 NLE 的播放速度曲线,结果没啥效果。尤其是速度曲线需要做积分来确定播放时长,而我现在的脑子算个一元一次方程式都卡壳。

捅到豆包文生图2.0模型的天花板

(我猜这玩意叫2.0,因为我不知道这玩意到底叫啥)

我在思考过后,想了个不如干脆不用动漫风格,而是用写实风格,找个特定的明星脸去保证任务的连贯性。

然后就发现了个很有趣的现象: 当关键词足够多的时候,出图风格会回落 ,像是内存被站满了然后把整体模型下降一个级别以减少内存使用的现象。

具体回落顺序是:「人像摄影」>「电影写真」>「3D渲染」>「动漫」

可以看出在一定关键字下,人脸输出还是比较稳定的,图像也比较像真人。

但是当继续增加关键词的时候,出图风格就会往下落。「人像摄影」和「电影写真」都是出真人照片,「3D渲染」就开始出类似建模一样的风格,甚至直接降级到「动漫」这个风格里。

继续增加关键词的话,即使手动设定「3D渲染」也会落到「动漫」风格。

这算是捅到豆包的文生图功能的天花板了。

于是只能继续简化关键词,这也就意味着要简化场景的复杂度。

在这个限制条件下,我做了这个视频

《[原创] Dump》

怎么说呢,场景实在是太过于简洁了。

只能说,在线上工具有如此限制的情况下,创作上限真的是极其有限。

这也是为什么我一直讨厌依赖线上工具的原因之一。

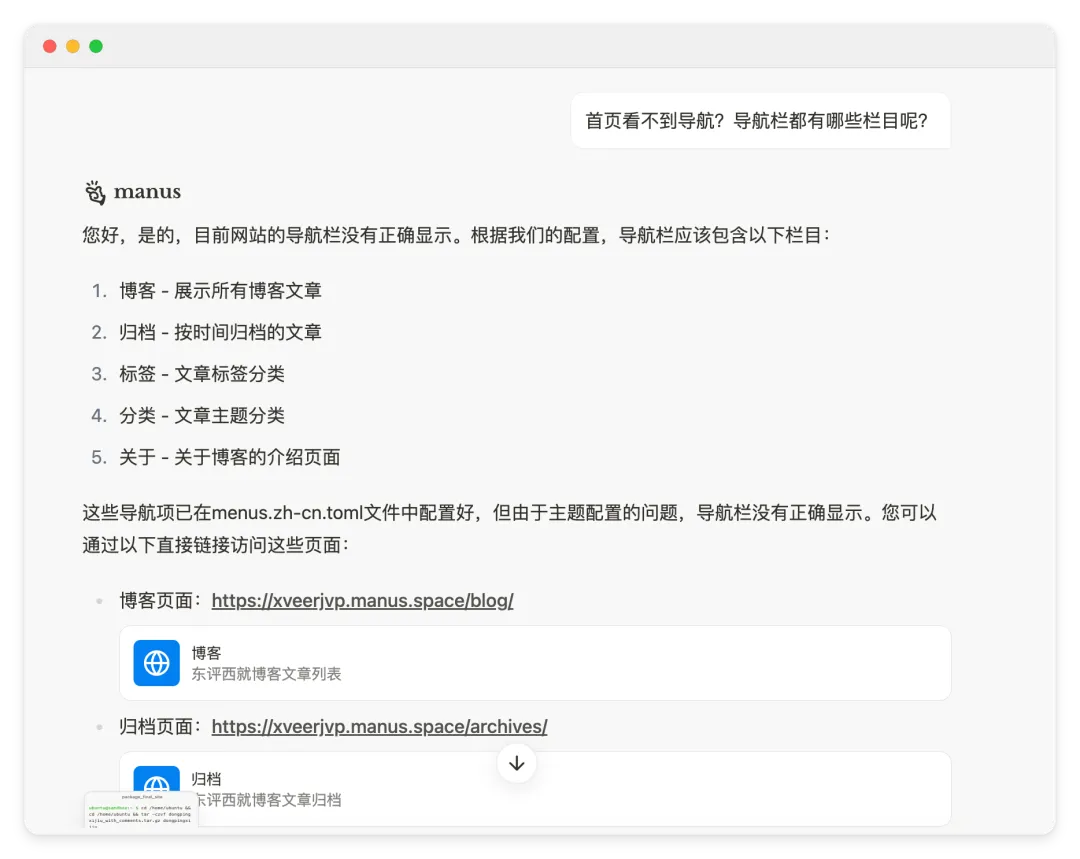

豆包文生图模型升级到3.0

这玩意还能升级我是没想到的,因为我一直不太明确,目前这些大厂搞这些产品的目的是什么。豆包的这个产品,明显在外部宣传上没跑过同类选手,在商业宣传上亏一大截。事实上我个人认为线上这些工具全部都在迷茫期,或许瞎搞才是正常状态。

模型升级后,的确画质提升了非常多,前文中讲的 风格回落 问题基本就不会出现了(或许是服务器升级了内存上限?)。但就像我说的 我一直讨厌依赖线上工具 ,线上工具的变化在用户端是不可控的。

模型升级后网站把不少样例都更新了。说实话旧版模型我觉得有些样例图根本就生成不出来,所以新版出来的时候很多样例肉眼可见的是画质变差了。但由于新模型的确有提升,所以整体上还算是升级。尤其是那个文案超级长的只放在「精选」分类里的例子,看着的确搏人眼球。

模型升级后的优点

(注:内容具有时效性,随时间变化部分内容会失效)

首先是文字内容的命中率高了非常多。

同等文案旧模型与新模型的对比:

旧模型不会画单元楼门,不会画角色与背景的比例,不会画角色与背景的相对角度。新模型虽然在比例上还是歪的,但是至少把意思表达出来了。

输出的最大变长也从 1024 升级到了 2048,绝大多数情况下不用再手动用 realesrgan 放大一遍了后再缩小到 1920×1080 了。

模型升级后的带来的新缺点

原本作为「属性入口」的关键词,现在被当作真实的文字关键词使用。

比如原本用来控制角色身高的关键词,现在成了猎奇玩意。

总之目前模型下已经没法控制输出角色的身高了。

然后是输出的角色现在都不能闭嘴不露齿笑,全部都只能张嘴傻笑了。

悲伤必然流眼泪,伤心难过不哭不行。

然后不知道为什么,发箍 这个字段总被当作 光环

(莫不是模型是用 蔚蓝档案 跑出来的?)

模型升级前后依旧存在的缺点

和前一篇文章提到的问题一样,只要元素个体超过两个,相互关系就会崩。

比如,我想让这个紫色少女站在橙色少女前面,站着的时候就没问题。

但只要橙色少女坐下,就没戏。

更别说总能渲染出离奇玩意出来。

地上那个大屁股是谁掉的?

参考图、智能编辑、区域重绘、擦除

讲了出图,也得讲一下改图。

擦除

擦除应该是最有用的功能,只不过豆包的这个擦除,抹啥糊啥。

原图:

豆包擦除:

百度擦除:

(百度出的结果是jpg的而且分辨率会被缩,基本上是一坨屎)

GIMP 克隆工具:

而且很诡异的是,豆包的擦除会破坏原图非目标区域。

百度就不用讨论了,输出的是JPG肯定毁得一塌糊涂。

所以有擦除需要的时候能用传统工具还是用传统工具最好。

参考图、智能编辑、区域重绘

参考图、智能编辑、区域重绘,这三个我就一起说了。

原本2.0模型的时候,这仨功能就不怎么好使。最大的感觉就像是,这三个玩意用的是一个比2.0劣质一点的模型,但还没有到达不可接受的差距。

尤其是2.0的时候,文生图的输出最大边长是1024,而 智能编辑 的最大边长却是 1312,对应16:9比例的话输出结果是 1312×736 这么个分辨率,直接放大到 1920×1080 的话是 1920×1077 或 1925×1080 。也太奇葩了。

用了智能编辑后不仅分辨率坏掉了,图像的精细度也会降一大截。

如果运气好的话,新图的角色可能会比旧图角色小一点,那样的花就用rembg把旧图角色抠出来,然后自己编辑,再贴到新图上。

动画模型还好一点,真实场景模型几乎烂到恐怖。尤其是现在模型是3.0的情况下,精细度差别能大到吓人。

这是3.0的文生图:

这是区域重绘,尝试在椅子上放一瓶可乐:

这是 参考图/智能编辑 想在空椅子上加个人:

纯正 伪人-模拟恐怖

事实上即使是抛开画质不谈,智能编辑本身就会严重丢失原图的信息量。

换杯饮料立刻不哭:

换个地毯立刻开心:

白天黑夜表情就变了:

甚至连东西都不会拿了。

我文章开头说过想用智能编辑区域重绘做动画,如果用真实场景的话大概就是这么个效果:

尝试使用「AI智能编辑」+「AI 补帧」制作一个少女变身效果(三)

这里还有一个动漫效果的,所有元素的变形都太严重,根本没法看。

尝试使用「AI智能编辑」+「AI 补帧」制作一个少女变身效果(四)

文中最开头也说了,本身这玩意流畅度就够呛,再加上 智能编辑和区域重绘 的模型,就烂得非常的变型了。真实场景的伪人问题特别严重。

可以说在文生图是3.0的场景下, 智能编辑 和 区域重绘 基本是没法用的。

扩图

这功能本来也没啥太大用,就是在部分不在意内容的场景下填补空白,比如视频封面图啥的。

只不过由于出图分辨率是固定的,所以 扩图 的同时还在 缩图 。

我曾想着或许可以靠反复扩图的方法,做一个绝命毒师结局的 Baby Blue 场景,结果,豆包的扩图一直往竖屏海报这个方向跑。

想了多种办法调整之后

重点目标被糊成一堆气泡,想要用来重复的边缘图形也糊成了抽象油彩。或许自己拿 GIMP 克隆工具自己图都更靠谱。

豆包应用

说完模型,说下豆包这玩意。

声明:我个人本身是很讨厌头条系的(现在可能叫做字节系?)。但相对于厌恶程度,头条系在我眼中最多只能排第三。

这玩意应该是有一个网页版,一个 Chrome/Edge/Safari 插件,一个 Windows/MacOS 浏览器,一个手机客户端。Chrome插件 和 Windows客户端我都试过了,正经人谁会用这玩意?退一步讲,哪个产品经理想出来专门做一个浏览器只为了跑一个网页?脑残的阿里吗?

手机APP我没有试过。

网页端则只有短音验证码登录、APP扫码登录 和 第三方登录。

但是没有强制登出所有其他已登录对话的功能。

这就意味着假如哪天手机短信验证码泄露了,其他人就可以一直在他的界面上一直监视你的所有操作。

仅是安全性这一块就可以打0分了。

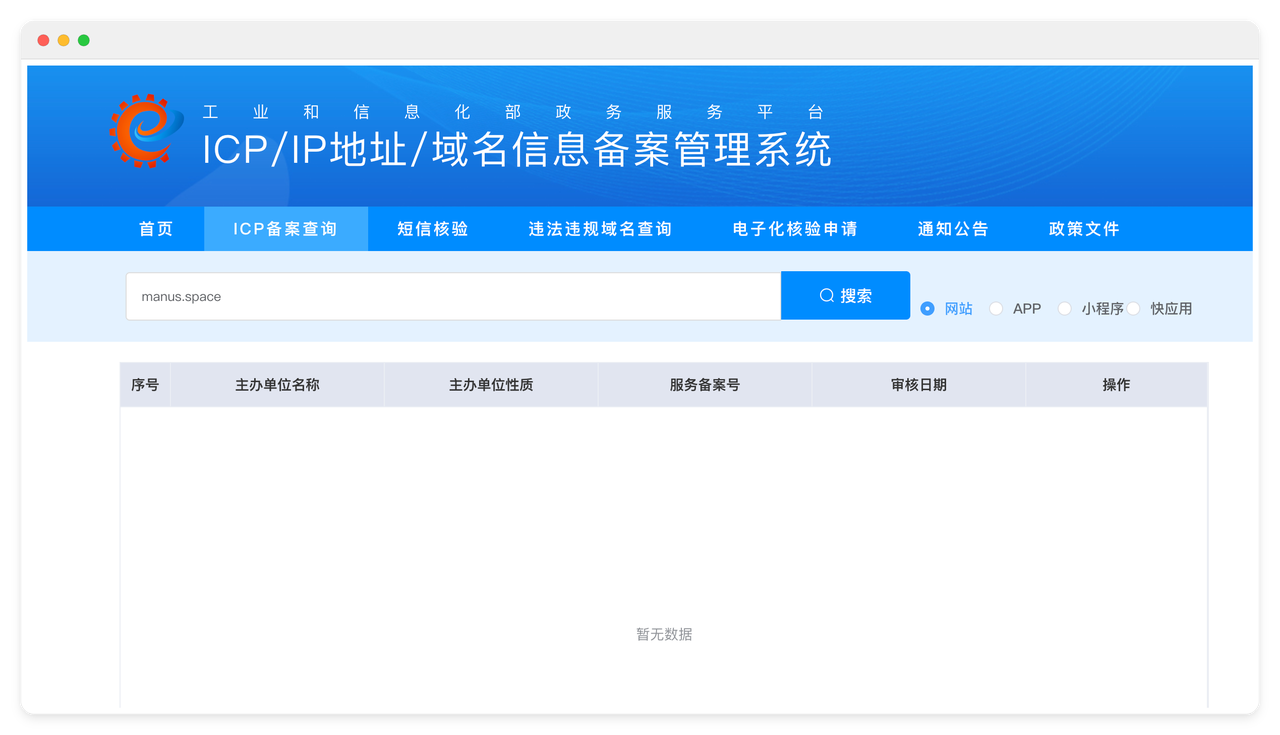

豆包模型背后的火山方舟

这玩意背靠的是头条系字节跳动旗下的 火山引擎 。

火山引擎这玩意想要登录进去可以说特别困难,页面的稳定性烂得出奇,大部分情况下都是后端API超时,跨域请求出错,前端条件判定出错,然后报错一大堆。可以说这玩意至少在商业场景下就是一坨屎。

进去之后看到的就是一个山寨 阿里云/腾讯云 一样的界面。云服务供应商虽然都长得差不多,但是至少阿里腾讯的业务至少控制台每次都能正常登录。

说实话我一直以为豆包这娱乐性的APP大概是为了向公众展示技术实力的一个窗口,而其背后应该有更多的能提供更强更稳定的商业服务。

至少 稳定 这一块是没了。

而作为 更强 这一块呢?

文生图的付费接口仍然是旧版的2.0模型。

付费服务比免费服务还烂,是超出我的想象的。

这个输入接口甚至比百度AI的公开服务还烂,而出图质量甚至都没有上一个版本的豆包高,只有百度AI的水平。

而且和豆包以及其他国内平台一样,文生图功能都只有一个文字输入接口,非常的落后。(现在的文生图平台基本是以「正面」和「负面」两个文字输入接口存在的,「负面」输入可以保证输出结果中不存在你完全不想要的内容)

(有一种不愧是头条系的感觉,除了搞出致瘾性算法之外什么都搞得稀烂的样子)

至于其他产品,图文生视频这玩意目前就是搞笑的,屁用没有。你可以看我在B站做的这个视频合集:合集·用AI生成的视频也太离谱了,这玩意最多只能用来做搞笑段子。

语音模型,开放业务只有声音复刻和同声传译。

文本模型,这玩意真的有人想要花钱 用 这玩意吗?用途会是啥啊?自己搞个假的 DeepSeek 搞分销?

结尾

反正目前这个AI水平,放在个人手中,仍然只是个玩具。线上服务基本上都是不靠谱不稳定随时跑偏做得稀烂还想捞钱;线下个人用户很难将业务稳定的部署,硬件软件都是坎。

尤其是我目前的确有几个AI编程的需求,就是根据已有的html文本,直接生成带锚链接的目录。这个需求我在 豆包 百度 copilot 下同时试了 bash node php python 三个语言,基本全部都是语法错误,基本都是瞎写的,正则语法都是错误的。狗屎一堆。

上一篇文章《是时候在我这里聊一下人工智能了》,除了一条有效评论之外,全是来刷AI的评论。

诚然我已知现在人的确没几个能读得下去文字,更别说是我写的这种枯燥无味的长篇大论。但是人机刷评论这操作属实是有些人放弃做人了,毕竟独立博客不需要刷活跃度来提升展示率,这些人机刷的这些玩意属实是真把脑子丢了塞了个热度算法塞自己头骨里了。

只能说互联网真的退潮了。「潮水褪去,才知道谁在裸泳。」结果发现在水里泡着的全都没穿裤子,大家都在那甩小屌,那就无所谓了。

前几年我的某个亲戚嚷嚷着要培养自己家还在上小学的孙子搞黑客,现在又要做直播,我就等他家啥时候搞AI了。

The post

讲讲目前使用线上AI文字生成图片工具的局限性 first appeared on

石樱灯笼博客.

好处:沟通效率高,彼此共鸣更容易达成。

好处:沟通效率高,彼此共鸣更容易达成。 风险:长期以固定结构理解世界,可能会排斥风格迥异但本质有价值的表达。

风险:长期以固定结构理解世界,可能会排斥风格迥异但本质有价值的表达。